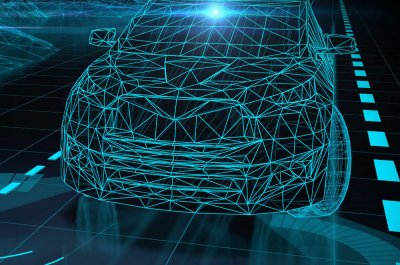

Vergessen Sie Turing oder den Lovelace-Test bei Künstlicher Intelligenz: Ich will sehen, wie ein Roboter den Frampton-Test besteht. Lassen Sie mich erklären, wie Rocklegende Peter Frampton in die Debatte über Künstliche Intelligenz (KI) geriet. Viele Jahrhunderte lang überlegte man, wie Menschen und Tiere unterschieden werden könnten. Heutzutage versucht man herauszufinden, inwiefern sich Menschen von Maschinen unterscheiden. Der britische Codeknacker und Computerpionier Alan Turing hat ein “Imitationsspiel” vorgeschlagen (auch bekannt unter dem Namen Turingtest), um herauszufinden, ob eine Maschine etwas kann, dass die Menschen ganz besonders lieben: sich zu unterhalten. Wenn ein menschlicher Sachverständiger die Maschine nicht ganz genau von einem Menschen durch die Konversation unterscheiden kann, gilt der Test als bestanden. Zunächst schlug Turing vor, dass man herausfinden solle, ob Maschinen denken können, aber bald stellte sich heraus, dass die Menschen, so sehr sie auch mitdenken können, keine genaue Definition vom Denken haben.

Den Turingtest überlisten

Vielleicht sagt es etwas über eine andere menschliche Qualität aus, und zwar die Verschlagenheit, dass der Turingtest den Programmierern dazu dient, die menschlichen Entscheider zu überlisten, anstatt eine Art ausreichende Intelligenz zu verkörpern, um eine glaubwürdige Konversation zu ermöglichen. Der Höhepunkt fand am 7. Juni 2014 statt, als Eugene Goostman etwa ein Drittel der Teilnehmer am Turingtestwettbewerb der Royal Society davon überzeugte, dass “er” ein 13-jähriger Schuljunge aus der Ukraine sei. Eugene war ein Chat-Bot, ein Computerprogramm, das dazu erschaffen wurde, um mit Menschen zu sprechen. Oder, um mit anderen Chat-Bots zu reden, was einen etwas surrealen Effekt ergibt.

Manche Kritiker waren schnell dabei, auf das künstliche Setting hinzuweisen, in dem diese Irreführung stattgefunden hatte.

Der kreative Geist

Der Chat-Bot namens Eugene brachte die Forscher dazu, einen elaborierteren Fehdehandschuh zu werfen: sie sollten kreativ sein! Im Jahr 2001 hatte das Forscherteam um Selmer Bringsjord, Paul Bello und David Ferrucci den Lovelace-Test vorgeschlagen, welcher nach der Mathematikerin und Programmiererin Gräfin Ada von Lavelance benannt wurde, und einen Computer benötigte um etwas wie eine Geschichte oder ein Gedicht zu erschaffen.

Solche computergenerierten Geschichten oder Gedichte gibt es schon eine ganze Weile, aber um den Lovelace-Test zu bestehen, darf derjenige, der das Programm erstellt hat, ebenfalls nicht in der Lage sein, zu erklären, wie die Kreativität entstanden ist. Mark Riedl, von der School of Interactive Computing an der Georgia Tech, hat ein Upgrade herausgebracht (Lovelace 2.0), das einen Computer in eine fortschreitende Reihe von anspruchsvollen und kreativen Aufgaben rückt. Und so beschreibt er Kreativität:

In meinem Test haben wir einen menschlichen Entscheider, der an einem Computer sitzt. Sie wissen, dass sie mit einer KI zu tun haben, und sie geben ihr eine Aufgabe, die aus zwei Teilen besteht. Zuerst fragen sie nach einem kreativen Objekt wie einer Geschichte, einem Gedicht oder einem Bild. Als Zweites geben sie ein Kriterium an: ‘Erzähl mir eine Geschichte, in der eine Katze jemanden rettet’ oder ‘Male mir ein Bild, in dem ein Mann einen Pinguin an der Hand hält’ zum Beispiel.

Was ist so toll an Kreativität?

So herausfordernd wie Lovelace 2.0 vielleicht sein mag, muss man doch bedenken, dass wir Kreativität nicht höher werten sollten als andere menschliche Fähigkeiten. Diese (sehr kreative) Einsicht von Dr. Jared Donovan kam in einer Podiumsdiskussion auf, die er mit Professor Michael Milford und dem Choreographen Kim Vincs auf der Robotronica 2015 im August geführt hat. Inmitten all der Warnungen, dass KI eines Tages das Ende der Menschheit bedeuten könnte, war das Ziel der Diskussion, herauszustellen wie der derzeitige Stand bezüglich Kreativität und Maschinen ist. Die Diskussion entwickelte die Frage, welche Art Gefühle wir bei intelligenten Maschinen erwarten würden. Empathie, die Fähigkeit, Gefühle untereinander zu verstehen und zu teilen, war ganz oben auf der Liste der erwünschten menschlichen Qualitäten. Vielleicht weil dies etwas ist, was über die bloße Feststellung hinaus geht (“Ich sehe, dass du wütend bist”), und eine Reaktion verlangt, die eine emotionale Wertschätzung demonstriert.

Und nun kündige ich den Frampton-Test an, der anhand der Frage der Rocklegende Peter Frampton entwickelt wurde, der in seinem Song aus dem Jahr 1973 fragte: “Do you feel like we do?” (dt.: Fühlst du wie wir alle?). Natürlich ist das nicht ganz ernst gemeint, aber ich kann mir gut vorstellen, dass eine KI, um den Frampton-Test zu bestehen, in der entsprechenden Situation eine überzeugende und emotional angebrachte Antwort geben können müsste, die bei den meisten Menschen Gefühle hervorrufen sollte. Ich sage “bei den meisten”, denn unsere Spezies besitzt verschiedene Ebenen der emotionalen Intelligenz.

Ich teile dieses Gefühl

Bedenkt man, dass andere bereits diese Themen untersucht haben und dass das Feld des “affective computing” anstrebt, die Maschinen mit der Fähigkeit zu durchdringen, Empathie zu simulieren, ist es noch immer faszinierend, sich die Auswirkungen der emotionalen Maschinen anzuschauen. Im vergangenen Juli haben Forscher von KI und Robotertechnik einen offenen Brief veröffentlicht, der sich mit der Gefahr der autonomen Waffen beschäftigt. Hätten die Maschinen auch nur einen Funken Empathie, würden wir diese Entwicklungen genauso fürchten? Wir erinnern uns auch daran, dass menschliche Gefühle nicht immer positiv sind: es gibt noch Hass, Wut, Missgunst und so weiter. Vielleicht sollten wir dankbar sein, dass die Geräte, die uns umgeben, diese Gefühle nicht wiederspiegeln (Können Sie sich ein mürrisches Siri vorstellen?).

Und trotzdem gibt es Situationen, in denen unsere großzügigeren Emotionen eher gefragt sind: Sympathie und Verständnis für Gesundheitsvorsorge, zum Beispiel. Auch wenn all diese Fragen durchaus ihrer eigenen Betrachtung bedürfen, konnten die Redner auf der Robotronica nicht auflösen, ob die Roboter eines Tages tatsächlich kreativ sein könnten, oder ob wir überhaupt wollen würden, dass sie dies lernen. Was maschinelle Gefühle angeht, wird der Frampton-Test noch eine Weile bestehen, schätze ich. Momentan sind die stärksten Gefühle, die ich bei Robotern erkennen kann, die, die von ihren Schöpfern ausgehen.

Dieser Artikel wurde durch die Podiumsdiskussion über den Lovelace-Test (“Können Roboter kreativ sein?”) bei der Robotronica 2015 angeregt. Ich bedanke mich sehr für die kreativen Einblicke der Diskussionsleiter Dr Jared Donovan (QUT), Associate Professor Michael Milford (QUT) und Professor Kim Vincs (Deakin).

Dieser Artikel erschien zuerst auf “The Conversation” und steht unter CC BY-ND 4.0. Übersetzung von Anne Jerratsch.

Image (adapted) „Artificial Intelligence“ by Global Panorama (CC BY-SA-2.0)

Artikel per E-Mail verschicken

Schlagwörter: Emotionen, KI, kreativität, Künstliche Intelligenz, Lovelace, Menschen, roboter, Turing

![Artificial Intelligence (adapted) (Image by Global Panorama [CC BY-SA 2.0] via Flickr)](https://www.netzpiloten.de/wp-content/uploads/2015/09/Artificial-Intelligence-adapted-Image-by-Global-Panorama-CC-BY-SA-2.0-via-Flickr-1024x500.jpg)