In der heutigen Welt voller Daten wollen Unternehmen, Regierungen und Einzelpersonen alles, was sie in die Hände bekommen können, analysieren – und das World Wide Web verfügt über jede Menge Informationen. Derzeit ist das am leichtesten zu erschließende Material aus dem Internet der Text. Aber nicht weniger als 89 bis 96 Prozent der Inhalte im Internet sind eigentlich etwas anderes – Bilder, Video- und Audio-Daten, in all den Tausenden von verschiedenen Arten von nichttextlichen Datentypen.

Darüber hinaus ist die überwiegende Mehrheit der Online-Inhalte nicht in einer Form verfügbar, die leicht von elektronischen Archivierungssystemen wie Google erschlossen werden kann. Für vieles muss man als Benutzer eingeloggt sein oder bekommt Dinge dynamisch durch ein Programm bereitgestellt, das ausgeführt wird, wenn ein Benutzer die Seite besucht. Wenn wir all das online verfügbare menschliche Wissen katalogisieren wollen, müssen wir sicher sein, dass wir auch auf alles zugreifen und alles einsehen können, und dass dies automatisch funktioniert.

Wie können wir Computern beibringen, verschiedene Arten von Material, das online verfügbar ist, zu erkennen, zu erschließen und zu suchen? Dank bundesstaatlicher Anstrengungen im globalen Kampf gegen Menschenhandel und Waffenhandel ist meine Forschung die Basis für ein neues Werkzeug, das bei dieser Aufgabe helfen kann.

Verstehen, was zum ‚Deep Web‘ gehört

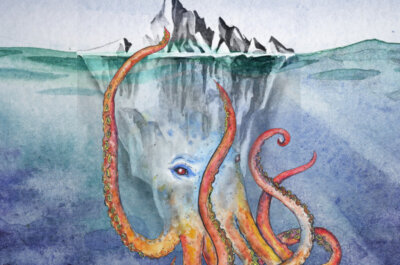

Das Deep Web und das Dark Web werden oft im Zusammenhang mit beängstigenden Nachrichten oder Filmen diskutiert, in denen junge, intelligente Kriminelle mit illegalen Aktivitäten wie Drogenhandel und Menschenhandel oder Schlimmerem davonkommen. Was genau bedeuten die Ausdrücke der dunklen Seite des Internets?

Das ‚Deep Web‘ existiert seit Unternehmen und Organisationen, einschließlich Universitäten, große Datenbanken ins Netz gestellt haben, die die Menschen sich nicht direkt anzeigen lassen können. Um nicht zuzulassen, dass zum Beispiel jeder Unbefugte die Telefonnummern und E-Mail-Adressen von Studenten erhält, muss man sich an vielen Unis zuerst als Mitglied der Campus-Community einloggen, bevor man die Online-Verzeichnisse nach Kontaktinformationen durchsuchen kann. Online-Dienste wie Dropbox und Gmail sind öffentlich zugänglich und Teil des World Wide Web – aber sich die Dateien und E-Mails eines Nutzers auf diesen Seiten anzeigen zu lassen, erfordert eine individuelle Anmeldung, was unser Projekt nicht vorsieht.

Das ‚Surface Web‘ ist der Teil der Online-Welt, den wir sehen können – Shopping-Sites, Informationsseiten von Unternehmen, News-Portale und so weiter. Das ‚Deep Web‘ ist eng damit verwandt, aber weniger sichtbar für den Nutzer und auch nicht für Suchmaschinen, die das Web erkunden, um es zu katalogisieren. In mancher Hinsicht ist dies sogar noch wichtiger. Das ‚Deep Web‘ lässt sich meiner Meinung nach als Bestandteil des öffentlichen Internets beschreiben, der:

- den Benutzer zwingt, zuerst ein Login-Formular auszufüllen,

- dynamische Inhalte wie AJAX oder Javascript enthält, oder

- Bilder, Videos und andere Informationen auf eine Weise präsentiert, die normalerweise nicht von Suchmaschinen angezeigt wird.

Was ist das ‚Dark Web‘?

Als ‚Dark Web‘ werden hingegen Seiten bezeichnet, die von Webservern unter Verwendung des anonymen Webprotokolls Tor (kurz für: The Onion Router) gehostet werden. Einige von ihnen können auch „Deep Web“-Elemente enthalten. Ursprünglich von Forschern des Verteidigungsministeriums entwickelt, um sensible Informationen zu sichern, wurde Tor im Jahr 2004 öffentlich zugänglich gemacht.

Wie bei vielen Sicherheitssystemen ähnlich, war der ursprüngliche Zweck ein guter, wurde dann aber auch von Kriminellen verwendet, um sich hinter der System-Anonymität zu verstecken. Einige Leute nutzen Tor-Sites für illegale Tätigkeiten wie Drogen-, Waffen- und Menschenhandel und sogar für Mordaufträge.

Die US-Regierung war daran interessiert, Wege zu finden, um moderne Informationstechnologie und Informatik zur Bekämpfung dieser kriminellen Aktivitäten zu nutzen. Im Jahr 2014 startete die Defense Advanced Research Projects Agency (besser bekannt als DARPA) ein Programm namens Memex zur Bekämpfung des Menschenhandels mit diesen Tools.

Genauer gesagt sollte Memex einen Suchindex erstellen, der der Strafverfolgung helfen würde, Menschenhandel online zu identifizieren – insbesondere durch das Durchstreifen des Deep- und des Dark Web. Eines der wichtigsten Systeme, das von den Projektteams, bestehend aus Wissenschaftlern, Regierungsmitarbeitern und Experten aus der Industrie, verwendet wurde, war eines, bei dessen Entwicklung ich mithalf: das sogenannte Apache Tika.

Der „digitale Babelfisch“

Tika wird oft als der „digitale Babelfisch“ bezeichnet, eine Anspielung auf eine Kreatur namens Babelfisch aus dem Roman „Per Anhalter durch die Galaxis“. Einmal in das Ohr einer Person eingeführt, ermöglicht es der Babelfisch, jede Sprache zu verstehen, die gesprochen wurde. Tika lässt die Benutzer jede Datei und die darin enthaltenen Informationen verstehen.

Wenn Tika eine Datei überprüft, identifiziert es automatisch, um welche Art von Datei es sich handelt – zum Beispiel ein Foto, ein Video oder eine Audio-Datei. Das Programm tut dies, indem es Informationen über Dateien systematisch organisiert: ihre Namen, ihre Größe, eine Art „digitaler Fingerabdruck“. Wenn es auf eine Datei trifft, deren Name beispielsweise mit „.MP4“ endet, nimmt Tika an, dass es sich um eine im MPEG-4-Format gespeicherte Videodatei handelt. Durch direktes Analysieren der Daten in der Datei kann Tika diese Annahme bestätigen oder widerlegen, denn alle Video-, Audio-, Bild- und andere Dateien beginnen zwangsläufig mit bestimmten Codes, die verraten, in welchem Format ihre Daten gespeichert sind.

Sobald ein Dateityp identifiziert ist, verwendet Tika spezifische Werkzeuge wie Apache PDFBox für PDF-Dateien oder Tesseract, um seine Inhalte für die Erfassung von Text aus Bildern zu extrahieren. Zusätzlich zum Inhalt werden andere forensische Informationen oder „Metadaten“ erfasst, einschließlich des Erstellungsdatums der Datei, wer sie zuletzt bearbeitet hat und in welcher Sprache die Datei erstellt wurde.

Von dort aus setzt Tika fortschrittliche Techniken wie Named Entity Recognition (NER) ein, um den Text weiter zu analysieren. NER identifiziert Eigennamen und Satzstruktur und vergleicht dann diese Informationen mit Datenbanken von Menschen, Orten und Dingen, wobei nicht nur identifiziert wird, von wem der Text spricht, sondern auch, wo und warum er es tut. Diese Technik half Tika, Scheinfirmen und andere Vorgänge automatisch zu identifizieren: Das Programm wusste, wo sich die globalen politischen, gesellschaftlichen und technischen Führer als Teil des Skandals um die Panama Papers und der finanziellen Korruption, befanden und an welchen Stellen sie Gelder versteckt hatten.

Identifizierung illegaler Aktivitäten

Verbesserungen an Tika während des Memex-Projektes machten es noch geeigneter für die Handhabung von Multimedia- und anderen Inhalten im Deep- und Dark Web. Jetzt kann Tika Bilder mit üblichen Anzeichen von Menschenhandel verarbeiten und identifizieren. So kann es beispielsweise Text in Bildern automatisch verarbeiten und analysieren, wie den Username eines Opfers oder einen Hinweis darauf, wie man es kontaktieren könnte – und bestimmte Arten von Bildeigenschaften – wie zum Beispiel Kamerabelichtungen. Bei einigen Bildern und Videos kann Tika sogar die Menschen, Orte und Dinge, die abgebildet sind, identifizieren.

Zusätzliche Software kann Tika helfen, automatische Waffen zu entdecken und die Seriennummern der Waffen zu identifizieren. Das kann dabei helfen, herauszufinden, ob sie gestohlen wurden oder nicht. Der Einsatz von Tika, um das Deep- und Darknet kontinuierlich zu überwachen, könnte helfen, Menschen- und Waffenhandelsituationen zu identifizieren, kurz nachdem die Fotos online veröffentlicht wurden. Das könnte ein Verbrechen frühzeitig verhindern und Leben retten.

Memex ist noch nicht leistungsfähig genug, um alle Inhalte zu handhaben, die es gibt, oder um die Strafverfolgung umfassend zu unterstützen, einen Beitrag zu humanitären Bemühungen zur Beendigung des Menschenhandels zu leisten oder mit kommerziellen Suchmaschinen zu interagieren.

Es ist noch viel Arbeit nötig, aber wir kommen der Sache näher, diese Ziele zu erreichen. Tika und verwandte Softwarepakete sind Teil einer Open-Source-Software-Bibliothek, die auf dem DARPA Open Catalog für jedermann – in den Strafverfolgungsbehörden, im Geheimdienst oder der breiten Öffentlichkeit – zur Verfügung steht, der das Deep- und Dark Web durchleuchten will.

Dieser Artikel erschien zuerst auf „The Conversation” unter CC BY-ND 4.0. Übersetzung mit freundlicher Genehmigung der Redaktion.

Image „abstract“ by geralt (CC0 Public Domain)

Artikel per E-Mail verschicken

Schlagwörter: apache tika, cyber kriminalität, dark net, dark web, DARPA, Daten, deep web, digitaler babelfisch, suchmaschine, surface web, Technologie, Tor