Wo auch immer wir online gehen, versucht jemand, unsere Weberfahrung zu personifizieren. Unsere Vorlieben werden vorweggenommen, unsere Absichten und Motivationen vorhergesagt. Der Toaster, den man sich vor drei Monaten kurz angeschaut hat, taucht immer wieder auf und geistert im Browser bei den Anzeigen in der Seitenleiste herum, die speziell auf uns angepasst wurden.

Und das passiert nicht nur auf diese Weise. Tatsächlich beeinflussen die ziemlich unpersönlichen Mechanismen mancher Personifizierungs-Systeme womöglich nicht, wie wir die Welt sehen, sondern wie wir uns selbst sehen.

Es passiert allen von uns, jeden Tag, wenn wir online sind. Der News-Feed auf Facebook versucht, speziell angepasste Inhalte zu liefern, die den individuellen Benutzer am meisten interessieren. Die Empfehlungsmaschine auf Amazon nutzt persönliche Datenverfolgung, kombiniert mit anderen Surfgewohnheiten der Benutzer, um relevante Produkte vorzuschlagen.

Google passt Suchergebnisse an und noch viel mehr: die Personifizierungs-App Google Now versucht zum Beispiel „uns die Informationen zu geben, die wir im Verlauf des Tages brauchen, bevor wir überhaupt danach fragen“. Solche Personifizierungs-Systeme zielen nicht einfach nur darauf ab, den Benutzern Relevanz zu liefern – mit Hilfe von genau geplanten Marketingstrategien erzielen sie durch viele der kostenlosen Webservice-Angebote auch Profit.

Die vielleicht bekannteste Kritik dieses Prozesses ist die sogenannte Bubblefilter-Theorie. Vorgeschlagen durch den Internet-Aktivisten Eli Pariser legt diese Theorie nahe, dass Personifizierung die Web-Erfahrung der Nutzer negativ beeinflussen kann.

Statt sich mit universellen und verschiedensten Inhalten auseinandersetzen zu müssen, wird den Nutzern über Algorithmen Material geliefert, dass zu ihren zuvor bestehenden, selbstbestätigenden Ansichten passt. Der Bubblefilter stellt deshalb ein Problem für das demokratische Engagement dar: indem man den Zugang zu herausfordernden und variierenden Ansichten einschränkt, sind Nutzer nicht dazu in der Lage, an kollektiven und kundigen Debatten teilzuhaben.

Versuche, Beweise für den Bubblefilter zu finden, haben unterschiedliche Resultate erzielt. Einige Studien haben gezeigt, dass Personifizierung in der Tat zu einer ‚kurzsichtigen‘ Ansicht zu einem bestimmten Thema führen kann. Andere Studien haben herausgefunden, dass Personifizierung in verschiedenen Kontexten sogar dabei helfen kann, gemeinsame und unterschiedliche Inhalte zu entdecken.

Meine Forschung suggeriert, dass die Personifizierung nicht einfach beeinflusst, wie wir die Welt sehen, sondern wie wir uns selbst sehen. Zusätzlich kann der Einfluss, den die Personifizierung auf unsere Persönlichkeit hat, möglicherweise nicht auf Bubblefilter des Verbrauchs zurückgeführt werden, sondern auf die Tatsache, dass Online-Personifizierung in einigen Fällen überhaupt nicht ‚persönlich‘ zugeschnitten ist.

Datenverfolgung und die Vorversorgung der Nutzer

Um dies zu verstehen, ist es sinnvoll, zu bedenken, wie Online-Personifizierung erreicht wird. Obwohl Personifizierungs-Systeme unsere individuellen Bewegungen im Web zurückverfolgen, sind sie nicht dafür geschaffen, unsere Identität als Individuum zu ‚kennen‘. Stattdessen sammeln diese Systeme die Echtzeit-Bewegungen der Nutzerin riesigen Datensätzen und suchen nach Mustern und Übereinstimmungen zwischen den unterschiedlichen Nutzerbewegungen.

Die gefundenen Muster und Übereinstimmungen werden dann in Identitätskategorien übersetzt, die wir möglicherweise wiedererkennen (wie zum Beispiel Alter, Geschlecht, Sprache und Interessen) und in die wir möglicherweise passen könnten. Da man sich die Massenmuster anschaut, um relevante Inhalte für eine jeweilige Person zu finden, basiert Personifizierung tatsächlich auf einem eher unpersönlichen Prozess.

Als die Bubblefilter-Theorie erstmals im Jahr 2011 auftauchte, argumentierte Pariser, dass eines der größten Probleme mit Personifizierung die Tatsache wäre, dass die Nutzer gar nicht wissen, das diese passiert. Heutzutage sind sich viele der Nutzer, trotz der Einsprüche gegen die Datenverfolgung, bewusst darüber, dass sie verfolgt werden. Sie erhalte im Gegenzug kostenlose Dienstleistungen. Ihnen ist bewusst, dass diese Verfolgung eine Form der Personifizierung ist. Weniger klar sind hingegen die Einzelheiten, wann und wie wir verfolgt werden und was die Personifizierung für uns bedeutet.

Das „Persönliche“ finden

Meine Forschungen suggerieren, dass manche Nutzer vermuten, dass ihre Erfahrungen auf sehr komplexe Weise personifiziert werden. In einer tiefergehenden qualitativen Studie mit 36 Internetnutzern, bei der sie Werbung für Produkte zur Gewichtsabnahme auf Facebook sahen, berichteten einige weibliche Nutzer, dass sie vermuten, Facebook würde sie als übergewichtig oder zumindest als gesundheitsbewusst einstufen.

Tatsächlich wurden diese Gewichtsabnahme-Werbungen generisch allen Frauen im Alter von 24 bis 30 gezeigt. Dennoch können solche zugeschnittenen Werbungen einen schädlichen Einfluss darauf haben, wie die Benutzer sich selbst sehen, da diese über die unpersönliche Natur mancher Personifizierungs-Systeme nicht Bescheid wissen. Um es etwas flapsig auszudrücken: Man muss übergewichtig sein, weil Facebook bestimmt, dass man es ist.

Nicht nur angepasste Werbungen können diesen Effekt erzielen: in einer ethnographischen und längslaufenden Studie, die mit ein paar 18- und 19-jährigen Google-Now-Nutzern durchgeführt wurde, fand ich heraus, dass manche Teilnehmer annahmen, dass die App zu einer Personifizierung bis zu einem außerordentlich hohen Grad fähig wäre. Die Nutzer berichteten, dass sie glaubten, Google Now würde ihnen deshalb Aktienkurse zeigen, weil Google weiß, dass ihre Eltern Aktien besitzen oder dass Google (fälschlicherweise) ein Wort wie „pendeln“ in „arbeiten“ geändert hätte, weil die Teilnehmer einmal auf ihren YouTube-Konten gelogen hatten und angegeben hatten, dass sie nicht mehr im Schulalter seien.

Selbstverständlich muss nicht noch zusätzlich erwähnt werden, dass diese kleine Studie nicht sämtliche Google Now-Nutzer repräsentiert. Doch sie suggeriert durchaus, dass für diese Individuen die versprochenen Voraussagen von Google Now beinahe unfehlbar waren. Tatsächlich legen Kritiken des nutzerorientierten Designs nahe, dass die eigentlichen Schlussfolgerungen von Google sehr viel unpersönlicher sind: Google Now nimmt an, dass ihr idealer Nutzer ein gewisses Interesse an Aktien hat – oder zumindest haben sollte – und dass alle Nutzer erwerbstätig sind und pendeln.

Solche Kritiken heben hervor, dass es diese Vermutungen sind, die zu großen Teilen den Rahmen für die Personifizierung Googles strukturieren (zum Beispiel durch die Festhaltung der App an vorgefertigten Karten-Kategorien, wie etwa ‚Sport‘, die während meiner Studie den Nutzern lediglich erlaubte, Männer-Fußballclubs statt Frauen-Fußballclubs in Großbritannien zu folgen).

Statt die Annahmen der App in Frage zu stellen, legt meine Studie dennoch nahe, dass die Teilnehmer sich selbst außerhalb der erwarteten Norm platzierten: sie vertrauten Google, dass es ihnen sagen würde, wie ihre persönlichen Erfahrungen auszusehen haben. Obwohl dies möglicherweise wie extreme Beispiele für unpersönliche algorithmische Schlussfolgerungen scheint, ist die Tatsache, dass wir nicht sicher sein können, was Personifizierung ist und wie und wann sie stattfindet, das größere Problem.

Für mich heben diese Aussagen der Nutzer hervor, dass das Anpassen der Online-Inhalte Auswirkungen hat, die über die Schädlichkeit für die Demokratie hinausreichen. Wenn wir nicht damit anfangen, zu verstehen, dass Personifizierung manchmal über höchst unpersönliche Programmiergerüste operieren kann, könnten wir eventuell zu viel Hoffnung darin setzten, dass uns die Personifizierung sagt, wie wir uns verhalten sollen und wer wir sein sollen – statt andersherum.

Dieser Artikel erschien zuerst auf „The Conversation“ unter CC BY-ND 4.0. Übersetzung mit freundlicher Genehmigung der Redaktion.

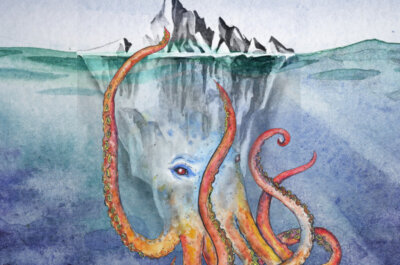

Image ”Identität” by TheDigitalWay (CC0 Public Domain)

Artikel per E-Mail verschicken

Schlagwörter: Aktienkurs, Algorithmen, Daten, demokratie, Erfahrungen, Forschung, Google Now, Identität, Internet, Kategorien, News-Feed, Nutzer, online, Prozesse, Studien, Theorie, web, werbung

![identitaet(image by TheDigitalWay[CC0 Public Domain] via Pixabay)](https://www.netzpiloten.de/wp-content/uploads/2016/09/identität-555x600.jpg)

1 comment